Sådan optimerer du intralogistikken for at strømline og fremskynde Industri 4.0-forsyningskæder – del to af to

Bidraget af DigiKeys nordamerikanske redaktører

2023-09-22

Del 1 af denne serie om intralogistik diskuterede spørgsmål relateret til, hvordan autonome mobile robotter (AMR’er) og automatiserede styrede køretøjer (AGV'er) bruges på systemniveau til at implementere intralogistik og hurtigt og sikkert flytte materialer efter behov. Denne artikel fokuserer på use-cases, og hvordan AMR'er og AGV'er anvender sensorer til at identificere og spore emner, hvordan maskinlæring (ML) og kunstig intelligens (AI) understøtter identifikation, bevægelse og levering af materialer gennem lager- og produktionsfaciliteter.

Intralogistik (intern logistik) bruger autonome mobile robotter (AMR'er) og automatiserede selvkørende køretøjer (automated guided vehicles/AGV’er) til effektivt at flytte materialer rundt på Industri-4.0-lagre og produktionsfaciliteter. For at strømline og fremskynde forsyningskæderne skal intralogistiksystemer kende materialets aktuelle placering, materialets planlagte destination og den sikreste og mest effektive vej for materialet til destinationen. Denne strømlinede navigation kræver en mangfoldighed af sensorer.

I intralogistikløsninger bruger AGV'er og AMR'er sensorer til at øge deres situationsfornemmelse. Sensorerne giver sikkerhed for personale i nærheden, beskyttelse af andet udstyr og effektiv navigation og lokalisering. Afhængigt af applikationskravene kan sensorteknologier til AMR'er omfatte kontaktsensorer som grænsekontakter indbygget i kofangere, 2D- og 3D-lysdetektering og -afstandsmåling (LiDAR), ultralyd, 2D- og stereokameraer, radar, encodere, inertimåleenheder (IMU'er) og fotoceller. For AGV'er kan sensorer omfatte magnetiske, induktive eller optiske linjesensorer samt grænsekontakter indbygget i kofangere, 2D LiDAR og encodere.

Den første artikel i denne serie handler om, hvordan AMR'er og AGV'er bruges på systemniveau til at implementere intralogistik og effektivt flytte materialer efter behov.

Denne artikel fokuserer på sensorfusion, og hvordan AMR'er og AGV'er anvender kombinationer af sensorer plus AI og ML til lokalisering, navigation og driftssikkerhed. Den begynder med en kort gennemgang af almindelige sensorer i AGV'er, undersøger robotposition og SLAM-algoritmer (simultaneous location and mapping) ved hjælp af sensorfusion, ser på, hvordan SLAM-estimater kan forbedres med scan-to-map matching og scan-to-scan matching-teknikker, og slutter med et kig på, hvordan sensorfusion bidrager til sikker drift for AMR'er og AGV'er. DigiKey støtter designere med et bredt udvalg af sensorer og kontakter til robotteknologi og andre industrielle applikationer i alle disse tilfælde.

En række sensorer og sensorfusion, AI, ML og trådløs forbindelse er nødvendige for at understøtte autonom drift og sikkerhed i AMR'er. Selvom kravene til AGV'ers ydeevne er lavere, er de stadig afhængige af flere sensorer for at understøtte sikker og effektiv drift. Der er to overordnede kategorier af sensorer:

- Proprioceptive sensorer måler værdier internt i robotten som hjulhastighed, belastning, batteriladning og så videre.

- Eksteroceptive sensorer giver information om robottens omgivelser, f.eks. afstandsmålinger, placering af pejlemærker og identifikation af forhindringer som f.eks. personer, der kommer ind i robottens bane.

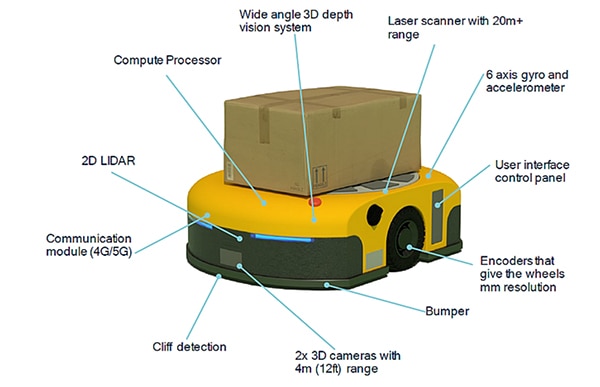

Sensorfusion i AGV'er og AMR'er er afhængig af kombinationer af proprioceptive og eksteroceptive sensorer. Eksempler på sensorer i AMR'er omfatter (figur 1):

- Laserscanner til objektdetektering med 20+ meters (m) rækkevidde

- IMU med et 6-akset gyroskop og accelerometer, og nogle gange også et magnetometer

- Encodere med millimeteropløsning (mm) på hjulene

- Kontaktsensor som en mikroswitch i kofangeren, der straks stopper bevægelsen, hvis et uventet objekt berøres.

- To fremadrettede 3D-kameraer med en rækkevidde på 4 m

- Nedadrettet sensor til at registrere kanten af en platform (kaldet klippe-detektion)

- Kommunikationsmoduler, der giver tilslutningsmuligheder og kan tilbyde Bluetooth-registrering af ankomstvinkel (AoA) og afgangsvinkel (AoD) til realtidslokaliseringstjenester (RTLS) eller 5G Transmission Points/Reception Points (TRP) til at plotte et gitter med centimeternøjagtighed.

- 2D LiDAR til beregning af afstanden til forhindringer foran køretøjet

- Vidvinkel 3D dybdesynssystem egnet til identifikation og lokalisering af objekter

- Højtydende computerprocessor ombord til sensorfusion, AI og ML

Figur 1: Eksempel på AMR, der viser diversiteten og positionerne af de indlejrede sensorer. (Billedkilde: Qualcomm)

Figur 1: Eksempel på AMR, der viser diversiteten og positionerne af de indlejrede sensorer. (Billedkilde: Qualcomm)

Robotposition og sensorfusion

AMR-navigation er en kompleks proces. Et af de første skridt er, at AMR'en ved, hvor den er, og hvilken retning den vender. Denne kombination af data kaldes robottens positur. Begrebet positur kan også anvendes på arme og sluteffektorer på stationære robotter med flere akser. Sensorfusion kombinerer input fra IMU, encodere og andre sensorer for at bestemme posituren. Posituralgoritmen estimerer robottens (x, y)-position og orienteringsvinklen θ i forhold til koordinatakserne. Funktionen q = (x, y, θ) definerer robottens position. For AMR'er har positurinformation en række anvendelser, herunder:

- En indtrængers positur, f.eks. en person, der kommer tæt på robotten, i forhold til en ekstern referenceramme eller i forhold til robotten.

- Robottens estimerede positur efter at have bevæget sig med en given hastighed i en forudbestemt periode

- Beregning af den hastighedsprofil, der er nødvendig for, at robotten kan bevæge sig fra sin nuværende positur til en anden positur

Positur er en foruddefineret funktion i flere softwareudviklingsmiljøer til robotter. For eksempel er pakken robot_pose_ekf inkluderet i Robot Operating System (ROS), en open source-udviklingsplatform. Robot_pose_ekf kan bruges til at estimere en robots 3D-positur baseret på (delvise) positurmålinger fra forskellige sensorer. Den bruger et udvidet Kalman-filter med en 6D-model (3D-position og 3D-orientering) til at kombinere målinger fra encoderen til hjulenes odometri, et kamera til visuel odometri og IMU'en. Da de forskellige sensorer arbejder med forskellige hastigheder og ventetider, kræver robot_pose_ekf ikke, at alle sensordata er tilgængelige kontinuerligt eller samtidigt. Hver sensor bruges til at give et positurestimat med en kovarians. Robot_pose-ekf identificerer de tilgængelige sensoroplysninger på ethvert tidspunkt og justerer i overensstemmelse hermed.

Sensorfusion og SLAM

Mange miljøer, hvor AMR'er opererer, indeholder variable forhindringer, der kan flytte sig fra tid til anden. Selvom et grundlæggende kort over anlægget er nyttigt, er der brug for mere. Når AMR'er bevæger sig rundt i et industrianlæg, har de brug for mere end positurinformation; de anvender også SLAM for at sikre effektiv drift. SLAM tilføjer kortlægning af omgivelserne i realtid for at understøtte navigationen. To grundlæggende tilgange til SLAM er:

- Visuel SLAM, der parrer et kamera med en IMU

- LiDAR SLAM, der kombinerer en lasersensor som 2D eller 3D LiDAR med en IMU

LiDAR SLAM kan være mere præcis end visuel SLAM, men det er generelt dyrere at implementere. Alternativt kan 5G bruges til at give lokaliseringsoplysninger for at forbedre visuelle SLAM-estimater. Brugen af private 5G-netværk på lagre og fabrikker kan supplere indlejrede sensorer til SLAM. Nogle AMR'er implementerer indendørs præcis positionering ved hjælp af 5G transmission points/reception points (TRP) til at plotte et gitter med centimeternøjagtighed på x-, y- og z-akserne.

Vellykket navigation afhænger af en AMR's evne til at tilpasse sig skiftende miljøelementer. Navigation kombinerer visuel SLAM og/eller LiDAR SLAM, overlay-teknologier som 5G TRP og ML for at registrere ændringer i miljøet og levere konstante positionsopdateringer. Sensorfusion understøtter SLAM på flere måder:

- Løbende opdateringer af den rumlige og semantiske model af miljøet baseret på input fra forskellige sensorer ved hjælp af AI og ML

- Identifikation af forhindringer, så baneplanlægningsalgoritmer kan foretage de nødvendige justeringer og finde den mest effektive vej gennem miljøet

- Implementering af stiplanen, der kræver realtidskontrol for at ændre den planlagte sti, herunder AMR'ens hastighed og retning, når omgivelserne ændrer sig.

Når SLAM ikke er nok

SLAM er et vigtigt værktøj til effektiv AMR-navigation, men SLAM alene er ikke nok. Ligesom posituralgoritmer er SLAM implementeret med et udvidet Kalman-filter, der giver estimerede værdier. SLAM-estimerede værdier udvider positurdataene og tilføjer blandt andet lineære og roterende hastigheder og lineære accelerationer. SLAM-estimering er en totrinsproces; det første trin involverer udarbejdelse af forudsigelser ved hjælp af interne sensoranalyser baseret på fysiske bevægelseslove. Det resterende trin i SLAM-estimeringen kræver eksterne sensoraflæsninger for at forfine de indledende estimater. Denne totrinsproces hjælper med at fjerne og rette små fejl, der kan akkumuleres over tid og skabe betydelige fejl.

SLAM afhænger af tilgængeligheden af sensorinput. I nogle tilfælde fungerer relativt billig 2D LiDAR måske ikke, f.eks. hvis der ikke er nogen objekter i sensorens direkte synsfelt. I disse tilfælde kan 3D-stereokameraer eller 3D LiDAR forbedre systemets ydeevne. Men 3D-stereokameraer eller 3D LiDAR er dyrere og kræver mere computerkraft til implementering.

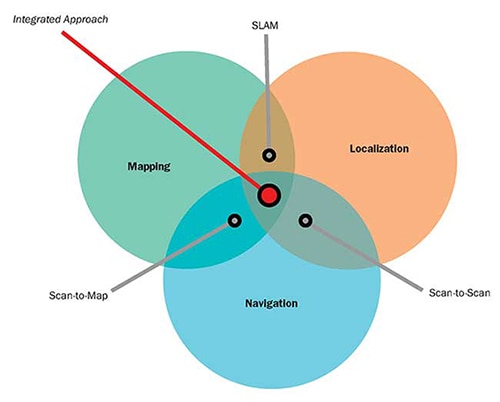

Et andet alternativ er at bruge et navigationssystem, der integrerer SLAM med scan-til-kort-matchning og scan-til-scan-matchningsteknikker, der kan implementeres ved kun at bruge 2D LiDAR-sensorer (figur 2):

- Scan-til-kort-matchning bruger LiDAR-afstandsdata til at estimere AMR'ens position ved at matche afstandsmålingerne med et gemt kort. Effektiviteten af denne metode afhænger af kortets nøjagtighed. Det oplever ikke drift over tid, men i gentagne miljøer kan det resultere i fejl, der er svære at identificere, forårsager diskontinuerlige ændringer i opfattet position og er udfordrende at eliminere.

- Scan-til-scan-matchning bruger sekventielle LiDAR-afstandsdata til at estimere en AMR's position mellem scanninger. Denne metode giver opdaterede oplysninger om placering og positur for AMR uafhængigt af eksisterende kort og kan være nyttig under oprettelse af kort. Men det er en inkrementel algoritme, der kan blive udsat for afvigelser over tid uden mulighed for at identificere de unøjagtigheder, som afvigelserne introducerer.

Figur 2: Scan-til-kort og scan-til-scan matching-algoritmer kan bruges til at supplere og forbedre SLAM-systemers ydeevne. (Billedkilde: Aethon)

Figur 2: Scan-til-kort og scan-til-scan matching-algoritmer kan bruges til at supplere og forbedre SLAM-systemers ydeevne. (Billedkilde: Aethon)

Sikkerhed kræver sensorfusion

Sikkerhed er en vigtig faktor for AGV'er og AMR'er, og flere standarder skal tages i betragtning. For eksempel American National Standards Institute / Industrial Truck Standards Development Foundation (ANSI/ITSDF) B56.5 - 2019, Safety Standard for Driverless, Automatic Guided Industrial Vehicles and Automated Functions of Manned Industrial Vehicles, ANSI / Robotic Industrial Association (RIA) R15.08-1-2020 - Standard for Industrial Mobile Robots - Safety Requirements, flere standarder fra International Standards Organization (ISO) og andre.

Sikker drift af AGV'er og AMR'er kræver sensorfusion, der kombinerer sikkerhedscertificerede 2D LiDAR-sensorer (også kaldet sikkerhedslaserscannere) med encodere på hjulene. 2D LiDAR understøtter samtidig to detekteringsafstande, kan have en sensorvinkel på 270° og koordinerer med køretøjets hastighed, som rapporteres af encoderne. Når et objekt registreres i den fjernere detekteringszone (op til 20 m væk, afhængigt af sensoren), kan køretøjet bremses efter behov. Hvis objektet kommer ind i den nærmeste detekteringszone i kørelinjen, stopper køretøjet.

Sikkerhedslaserscannere bruges ofte i sæt af 4, med en placeret på hvert hjørne af køretøjet. De kan fungere som en enkelt enhed og kommunikere direkte med sikkerhedskontrollen på køretøjet. Scannere er tilgængelige og certificerede til brug i sikkerhedskategori 3, Performance Level d (PLd) og Safety Integrity Level 2 (SIL2) og er indkapslet i et IP65-kabinet, der passer til de fleste udendørs og indendørs anvendelser (figur 3). Scannerne har en indgang til inkrementel encoderinformation fra hjulene for at understøtte sensorfusion.

Figur 3: 2D-lidarsensorer som denne kan kombineres med encodere på hjulene i et sensorfusionssystem, der giver sikker drift af AMR'er og AGV'er. (Billedkilde: Idec)

Figur 3: 2D-lidarsensorer som denne kan kombineres med encodere på hjulene i et sensorfusionssystem, der giver sikker drift af AMR'er og AGV'er. (Billedkilde: Idec)

Konklusion

Intralogistik understøtter hurtigere og mere effektive forsyningskæder i Industri 4.0-lagre og -fabrikker. AMR'er og AGV'er er vigtige værktøjer i intralogistikken til at flytte materialer fra sted til sted på en rettidig og sikker måde. Sensorfusion er nødvendig for at understøtte AMR- og AGV-funktioner, herunder bestemmelse af positur, beregning af SLAM-data, forbedring af navigationsydelsen ved hjælp af scan-til-kort-matchning og scan-til-scan-matchning og sikring af sikkerheden for personale og genstande i hele anlægget.

Disclaimer: The opinions, beliefs, and viewpoints expressed by the various authors and/or forum participants on this website do not necessarily reflect the opinions, beliefs, and viewpoints of DigiKey or official policies of DigiKey.